Siamo all’inizio dell’estate e i telegiornali si riempono di consigli su come combattere il caldo e i problemi che causa al nostro corpo, ma spesso si sottovaluta l’azione del calore sulle varie apparecchiature che utilizziamo, faccio due chiacchiere sui problemi del caldo su cineprese, lenti, hard disk, computer etc…

Quando stiamo lavorando all’aperto è facile che siamo sotto il sole, o anche se siamo sotto una tenda per proteggere le attrezzature dal sole, la temperatura sarà alta, e il rischio che le attrezzature lavorino meno bene è alquanto alta. Cerchiamo di capire quali possono essere le problematiche che possiamo incontrare.

Molti video maker sottovalutano il surriscaldamento del sensore e gli effetti di tale situazione sulla qualità delle immagini.

Molti video maker sottovalutano il surriscaldamento del sensore e gli effetti di tale situazione sulla qualità delle immagini.

Partiamo dal discorso più ovvio e banale, se la camera si surriscalda troppo tende a bloccarsi o spegnersi per evitare danni all’elettronica, come tale ci impedisce di lavorare o peggiorerà la qualità delle immagini. Più il sensore è sensibile come gamma dinamica e più la camera tenderà a generare calore, non a caso molto dslr fullframe si spengono dopo x minuti di utilizzo o bloccano la registrazione per evitare danni (e non solo per il limite burocratico dei 29 minuti 59 secondi altrimenti viene messa in categoria cinepresa). Diverse telecamere tendono ad avere problemi con il surriscaldamento generando artefatti nella compressione o banalmente più rumore video se si alza la sensibilità.

E’ noto che esistono delle modifiche per le fotocamere ad uso astronomico per raffreddare in modo sensibile il sensore e ridurre la quantità di rumore generata sia nelle lunghe esposizioni che nelle riprese ad alti iso. Esistono diversi studi per molte camere dove aumentando il sistema di raffreddamento il rumore originale tende a ridursi in modo molto sensibile, pur lavorando nella stessa identica condizione.

Una cinepresa digitale ha il suo sistema di raffreddamento e più si va in alto con la categoria (Arriflex e Red) hanno sistemi di stabilizzazione della temperatura del sensore per cui l’oscillazione possibile è di frazioni di un grado per offrire il meglio delle immagini. La prossima volta che faremo una ripresa con una qualunque camera (escluse le suddette fasce alte), potrebbe essere utile scoprire quale sia la sua miglior temperatura di utilizzo per capire meglio le diverse risposte di resa del dettaglio e cromatica.

Quindi quando si legge che una camera lavora da -20 a +45 gradi, questo non si significa che funzionerà al meglio, ma semplicemente che può funzionare in quelle condizioni.

Qualcuno potrebbe aver notato che non tutte le lenti sono con la cover nera, soprattutto le lenti più “ingombranti” esistono in “bianco”. D’estate, sotto il sole una lente completamente nera attira il calore, e il calore significa dilatazione termica degli elementi. Con la dilatazione delle lenti, dei meccanismi interni, delle ghiere etc possono bloccarsi o danneggiarsi. éer questa ragione alcuni produttori realizzano una versione chiara per ridurre il surriscaldamento delle suddette lenti. Indipendentemente dalla “vestizione” le lenti fanno parte di quegli oggetti che non devono surriscaldarsi, e se prendono meno sole possibile fa solo bene alla vita e alla durata di questi prodotti.

Qualcuno potrebbe aver notato che non tutte le lenti sono con la cover nera, soprattutto le lenti più “ingombranti” esistono in “bianco”. D’estate, sotto il sole una lente completamente nera attira il calore, e il calore significa dilatazione termica degli elementi. Con la dilatazione delle lenti, dei meccanismi interni, delle ghiere etc possono bloccarsi o danneggiarsi. éer questa ragione alcuni produttori realizzano una versione chiara per ridurre il surriscaldamento delle suddette lenti. Indipendentemente dalla “vestizione” le lenti fanno parte di quegli oggetti che non devono surriscaldarsi, e se prendono meno sole possibile fa solo bene alla vita e alla durata di questi prodotti.

Anche avvitare dei semplici filtri, se la filettatura si è surriscaldata, può diventare un’impresa perchè bastano pochi decimi di mm di dilatazione per non far funzionare la filettatura. Sotto il sole i filtri neutri o i filtri neutri graduali sono indispensabili per poter fare una ripresa esposta correttamente, per cui è importante proteggere le lenti dalle alte temperature, alle volte basta poco, una maglietta bianca o un fazzoletto posto sulla lente mentre non la usiamo per controllare il surriscaldamento.

Anche avvitare dei semplici filtri, se la filettatura si è surriscaldata, può diventare un’impresa perchè bastano pochi decimi di mm di dilatazione per non far funzionare la filettatura. Sotto il sole i filtri neutri o i filtri neutri graduali sono indispensabili per poter fare una ripresa esposta correttamente, per cui è importante proteggere le lenti dalle alte temperature, alle volte basta poco, una maglietta bianca o un fazzoletto posto sulla lente mentre non la usiamo per controllare il surriscaldamento.

I supporti sono robusti, le card reggono temperature molto estreme, reggono, non significa che funzionano a temperature molto estreme… quando si sottopongono le card SD e CF a temperature molto calde c’è il rischio che la dilatazione termica possa creare falsi contatti o problemi di contatti mentre state facendo la ripresa della vostra vita.

I supporti sono robusti, le card reggono temperature molto estreme, reggono, non significa che funzionano a temperature molto estreme… quando si sottopongono le card SD e CF a temperature molto calde c’è il rischio che la dilatazione termica possa creare falsi contatti o problemi di contatti mentre state facendo la ripresa della vostra vita.

Lo stesso discorso può essere applicato anche ai dischi nel momento in cui dovrete praticare il backup e la copia dei materiali sui dischi esterni.

Tutti i dischi meccanici si basano sulla scrittura magnetica con puntine che stanno in prossimità della superficie del disco. Se sopponiamo un disco a temperature più alte, possiamo avere più punti deboli della catena di trasmissione e registrazione dei dati:

Tutti i dischi meccanici si basano sulla scrittura magnetica con puntine che stanno in prossimità della superficie del disco. Se sopponiamo un disco a temperature più alte, possiamo avere più punti deboli della catena di trasmissione e registrazione dei dati:

- il disco magnetico se dilatato dall’alta temperatura potrebbe scrivere i dati con una leggera sfasatura di posizione rispetto alle indicazioni date dal firmware del disco, e quindi essere non leggibile in rilettura a temperatura di normale esercizio.

- il surriscaldamento del meccanismo di spostamento dei bracci può creare degli scontri tra i bracci e gli elementi intorno a se (un vecchio modello wd che conservo come esempio di pessima progettazione…)

- il surriscaldamento dei chipset di controllo del disco può corrompere i dati in scrittura, per cui è sempre importante fare copie dei dati con un software di verifica MD, in modo che durante la copia il software ricontrolla i dati scritti (se non avete o non sapete quale software scegliere, la versione free di DavinciResolve ha questa funzione sotto mac, win e linux).

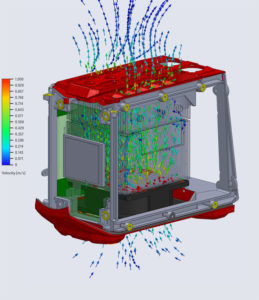

- Il box / la docking station del disco stesso surriscaldandosi potrebbe dare problemi di riconoscimento / lettura scrittura dei dati ad alte temperature. Ho usato diversi box per dischi, dischi di ogni tipo dai lacie a semplici maxtor, wd, fino a prodotti più professionali come G-Drive, ma le alte temperature possono mettere in difficoltà praticamente tutti questi prodotti sul set. Ho sperimentato dal docking station che ad alte temperature funziona con un connettore e non con un altro (usb 3.0 no thunderbolt), oppure che a surriscaldamento i dischi non vengono più riconosciuti dal raid, appena si raffreddano il sistema torna a funzionare. Il che potrebbe anche essere urtante per un sistema da quasi 2000 euro di dischi, ma gli ingegneri hanno pensato come mettere quasi cento tera dentro il box ma non un sistema di raffreddamento per gestire il surriscaldamento generato da tutti quei dischi fatti funzionare insieme al massimo della velocità.

Non dimentichiamo poi il nostro computer, ha due elementi che non solo generano calore, la CPU e la GPU, ma sono sensibili all’aumento della temperatura, raggiungendo determinati limiti il processore può ridurre le sue prestazioni, la scheda video si disabilita, oppure si arriva allo spegnimento completo del computer, impedendo il backup che stavamo facendo.

Non dimentichiamo poi il nostro computer, ha due elementi che non solo generano calore, la CPU e la GPU, ma sono sensibili all’aumento della temperatura, raggiungendo determinati limiti il processore può ridurre le sue prestazioni, la scheda video si disabilita, oppure si arriva allo spegnimento completo del computer, impedendo il backup che stavamo facendo.

Tutto questo senza contare che il caldo darà problemi alla nostra salute, alza la pressione, ci disidrata, ogni oggetto diventa caldo da tenere in mano, e ci abbronziamo… a luglio 2017 durante una giornata di riprese sotto il sole ho cambiato letteralmente colore, oltre al fattore rischio ustioni c’erano ben altre problematiche legate alla salute fisica, quindi facciamo attenzione all’attrezzatura, ma attenzione prima di tutto alla propria salute.