Nel 2001 naque il primo codec interpiattaforma e slegato dall’hardware, Cineform, nel 2005 fu potenziato per offrire la possibilità di importare fotografie raw di diversi brand e convertirle in un filmato raw compresso visually lossless con metadata attivi e modificabili realtime, successivamente l’encoder fu in grado di convertire tutti gli altri formati raw nati SUCCESSIVAMENTE in Cineformraw con diversi flavour di compressione e qualità supportando fino al 16k stereoscopico.

Nel 2001 naque il primo codec interpiattaforma e slegato dall’hardware, Cineform, nel 2005 fu potenziato per offrire la possibilità di importare fotografie raw di diversi brand e convertirle in un filmato raw compresso visually lossless con metadata attivi e modificabili realtime, successivamente l’encoder fu in grado di convertire tutti gli altri formati raw nati SUCCESSIVAMENTE in Cineformraw con diversi flavour di compressione e qualità supportando fino al 16k stereoscopico.

Oggi nel 2019 quasi ogni Brand ha la sua codifica Raw, a partire Arriraw, Redcode, SonyRaw, PanasonicRaw, l’anno scorso l’introduzione di ProresRaw che permette il recording in formato ProresRaw direttamente dalle camere che escono in raw da SDI sui recorder Atomos e pochi altri, fino al recente Braw di blackmagic.

A Ibc 2018 Blackmagic design lancia la palla nel campo del raw, introducendo il loro codec proprietario braw (blackmagic raw) nel mondo del broadcast e del cinema con una certa forza dirompente, e soprattutto disponibile subito, dallo stesso giorno con il firmware in beta 6.0 per la UrsaMiniPro, il nuovo aggiornamento di Davinci Resolve 15.1 per supportarlo e la promessa che a breve sarà disponibile anche per la nuova camera, pocket 4k e così è stato con il firmware 6.2, ma nel contempo toglieva la registrazione Dng.

La differenza tra il Dng e il Braw è evidente e chiara, il dng è uno standard fotografico, peraltro abbandonato dai suoi stessi creatori nel 2016, piegato alle necessità dei video, mentre il Braw è un moderno codec raw pensato per le immagini, dove convivono le diverse necessità di lavoro di un codec video di fascia alta e le richieste di fascia bassa.

La presentazione del Braw è stata abbastanza curiosa, dove GrantPetty ha scherzato sul fatto che con un codec così leggero non servono più le schede video esterne di decodifica, ironeggiando sul fatto che le producono loro per Apple.

La presentazione del Braw è stata abbastanza curiosa, dove GrantPetty ha scherzato sul fatto che con un codec così leggero non servono più le schede video esterne di decodifica, ironeggiando sul fatto che le producono loro per Apple.

Come sempre l’innovazione porta pro e contro, fautori e osteggiatori, fino al parossismo, ma essendo un pragmatico, preferisco fare una analisi meno tecnica (quella la lascio alla fase finale) e più pratica.

CONTRO

- leggermente meno nitido del CDNG (meno aliasing sui dettagli)

- a forti compressioni ha artefatti sui dettagli fini

- meno compatibile nelle applicazioni rispetto al CDNG (ma licenza free per la sua implementazione).

PRO

- il rapporto peso qualità è incredibile

- la minor incidenza di falsi dettagli e aliasing permette una maggior fluidità di ripresa-riproduzione del movimento

- il nuovo sistema di demosaicizzazione ottimizza e migliora la cattura della struttura dell’immagine riducendo artefatti come FPN

- la parziale demosaicizzazione applicata in camera permette una maggior leggerezza di lettura sui dispositivi

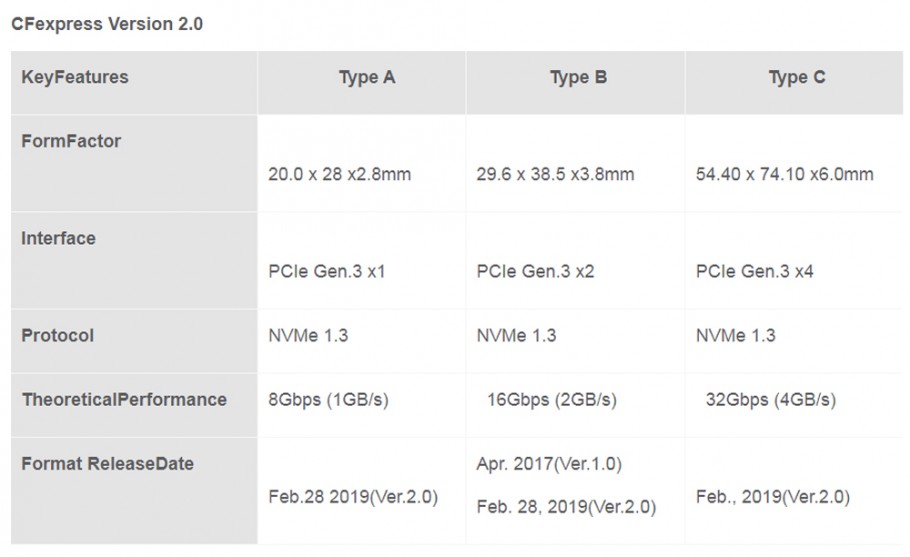

- richiesta di minor velocità di scrittura permette uso di storage meno costoso e poter registrare più a lungo con minor consumi

- i vantaggi del raw senza il peso del raw in tutti i sensi

- registrazione di segnale 12 bit log con metadata attivi

- possibilità di incorporare LUT e altri elementi di preview non distruttiva

- possibilità di trimming non distruttivo da Resolve per tagliare i file raw ed esportarli in raw senza ricompressione (non tutti i raw, non tutti gli NLE lo permettono).

- possibilità di export dei singoli frame raw senza ricompressione per test, Dit working etc con passaggio di pochi dati.

Dopo qualche mese dalla sua presentazione esistono già diverse applicazioni professionali a supportarlo come Resolve immediatamente, Nuke, Scratch, Premiere e Mediaencoder tramite plugin esterno, la lista sta crescendo rapidamente grazie al fatto che chiunque può implementare la gestione del braw nel proprio software gratuitamente, al contrario di ogni altro codec raw nato sulle telecamere che richiede un pagamento di licenze anche per la semplice lettura perchè si devono usare gli sdk proprietari.

Per coloro che vogliono testare il codec, possono scaricare dei sample dalla pagina Blackmagic Raw

In occasione del IBC2019 Blackmagic Design rilascia il kit 1.5 del BlackMagic raw, il kit contiene SDK, player e test per dischi Braw e … plugin per Premiere, AfterEffects e Avid per leggere agilmente il codec al di fuori delle applicazioni Blackmagic! Così che oggi buona parte degli editor sono in grado di leggere nativamente il codec BlackMagic Raw.

Inoltre stupendo tutti i detrattori del codec, rilascia il nuovo Video Assist HDR a 2500 nits con la capacità di registrare in Braw da camere NON BMD, dalla Panasonic Eva e dalla Canon C300 MkII!

Inoltre stupendo tutti i detrattori del codec, rilascia il nuovo Video Assist HDR a 2500 nits con la capacità di registrare in Braw da camere NON BMD, dalla Panasonic Eva e dalla Canon C300 MkII!

I falsi miti sul Raw in generale e non solo su questo Raw

Se è compresso non è raw!

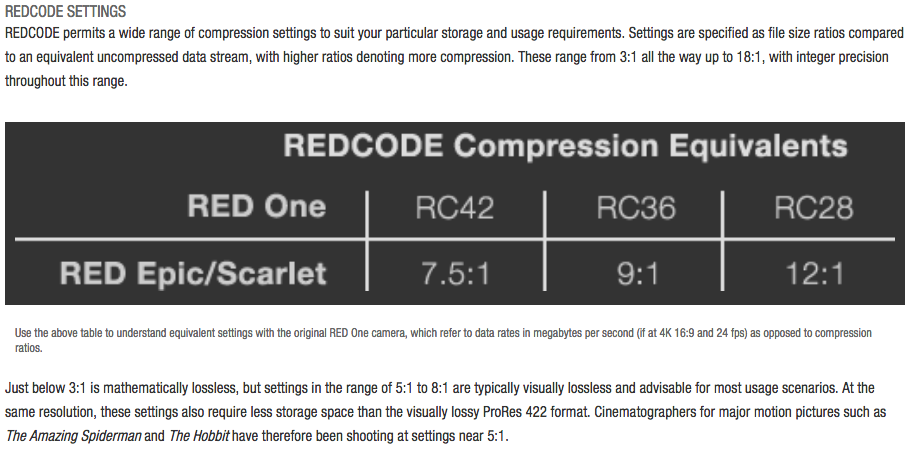

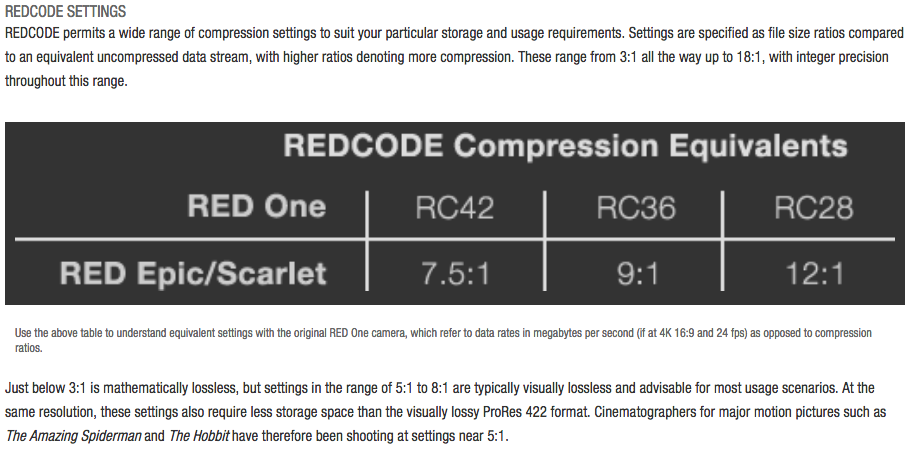

l’affermazione denota ignoranza, in tanti punti, a partire dal fatto che nessuna camera registra il 16bit lineare che catturano i sensori, ma lo codificano e comprimono in vario modo dentro raw 14bit logaritmici (in fotografia) o raw 12bit logaritmici (nel cinema), sia per questioni pratiche di flusso dati, sia per gestione fisica della massa di dati che non compressi sarebbero ingestibili.

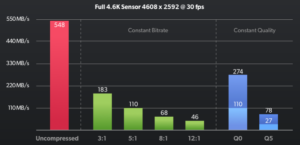

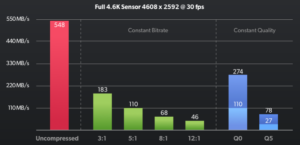

Dato che qualcuno potrebbe dubitare delle mie parole, delle parole di Blackmagic visto loro lo regalano (ricordiamo che tranne pochi esempi high end, tutti gli altri vi fanno pagare saltamente la registrazione non fortemente compressa, figuriamoci il raw) meglio mettere uno screengrab dal sito Red, i primi a dotare una camera di codec raw proprietario e spesso usate per shooting miliardari dove non ci sono limiti di mezzi, eppure per L’Uomo ragno ritenevano buona una compressione 5:1 visually lossless, e la non compressa che tutti auspicano per i loro lavori da caricare sui social non era adatta…

la cosa divertente è che quello che gli amatori ritengono un problema, ovvero la morbidezza delle immagini, è qualcosa che molti dop di fascia alta auspicano conoscendo bene i problemi degli eccessi di nitidezza, spesso vengono scelte compressioni maggiori per mantenere più morbide le immagini.

Ovviamente c’è compressione e compressione, la maggior parte delle persone per compressione pensa sempre a quella distruttiva di streaming e company non a compressione più intelligente.

Se è parzialmente demosaicizzato non è raw!

il braw, se la gente avesse la competenza e l’intelligenza per leggere l’sdk di Blackmagic vedrebbe cosa accade e perchè si parla di demosaicizzazione parziale, ma se lo potesse fare, non scriverebbe certe sciocchezze.

Ogni raw ha il suo workflow di lavoro, processi fatti in camera e processi fatti nel software, con vantaggi e svantaggi.

Un codec è raw se permette :

| |

Braw |

| la gestione delle matrici separate |

si |

| il controllo reale di iso e altri paramentri in post |

si |

| il controllo del bilanciamento colore in post |

si |

| registrazione dei 12 bit log per matrice |

si |

quindi se il codec offre tutte queste opzioni è un codec raw.

Si è bello ma non lo leggo dal software XYZ!

altra affermazione opinabile visto che anche gli altri codec non sono ben letti (con eccezione di Red) in modo ottimale dai vari NLE, anzi spesso richiedono la creazione di proxy con i software dedicati. Normalmente ai montatori non si danno gli originali, ma i giornalieri con Lut applicate, se si parla di raw o log, quindi il problema non sussiste.

altra affermazione opinabile visto che anche gli altri codec non sono ben letti (con eccezione di Red) in modo ottimale dai vari NLE, anzi spesso richiedono la creazione di proxy con i software dedicati. Normalmente ai montatori non si danno gli originali, ma i giornalieri con Lut applicate, se si parla di raw o log, quindi il problema non sussiste.

Oggi Bmd vende tre camere con il Braw, la UMP e la Pocket4k e 6k, vendute con licenza completa di DavinciResolve, ovvero il miglior software per lo sviluppo Raw e in particolare Braw, oltre che buon editor, postproduction etc etc… Con il VideoAssist 12g si può registrare in Braw anche dalla Canon C300 MKII e Panasonic EvaOne.

Se si vuole lavorare in un altro software Resolve prevede dal pannello media il sistema di ingest e conversione in altri formati, si può già fare una precolor oppure gestire direttamente la color e mandare il filmato sviluppato all’applicazione NLE.

La piccola rivoluzione relativa all’introduzione del Braw ha creato tanti osteggiatori, per chi ha dubbi e ha bisogno di più test scientifici e ben pensati, potete visitare il sito di Frank Glencairn sul post relativo alla qualità del Braw.

Dove mostra dei test pratici nei quali la differenza reale tra i diversi flavour di compressione è relativa, ma la qualità generale resta molto alta contro una serie di richieste generali veramente irrisorie.

Man mano che passa il tempo aggiungo qualche frame estratto a caso dagli shooting, senza denoise, per far capire quanto la qualità anche compressa sia eccezionale sia come dettaglio che pulizia dell’immagine.

iso 2000 BrawQ5

iso 2000 BrawQ5

Qui trovate quello che tutti vogliono, ma non sanno che è già in produzione, ed è la seconda iterazione di questo tipo di camere.

Qui trovate quello che tutti vogliono, ma non sanno che è già in produzione, ed è la seconda iterazione di questo tipo di camere.